Yapay zekâ çağında ahlaki bilgelik: Norbert Wiener’in teknoloji ve etik konusunda öncülüğü

Geleceğin dünyası, robot kölelerimizden bir şeyleri yapmalarını bekleyerek uzanabileceğimiz rahat bir hamak değil, zekâmızın sınırlarına karşı daha zorlu bir mücadele olacak.

“Zekâ iyi niyet anlamına gelir” diyor Simone de Beauvoir, yirminci yüzyılın ortalarında. O zamandan bu yana, değerlerimize uymayan bu yeni teknoloji çağıyla birlikte iyi niyetimize bir şeyler oldu. Dönüşüm şu: daha az ihtiyaç duyulan, neredeyse hiç kullanılmayan iyi niyet. Yapay zekâ ve gelişmiş algoritmalar, bizleri ahlaki duyarlılıktan uzaklaştırdı.

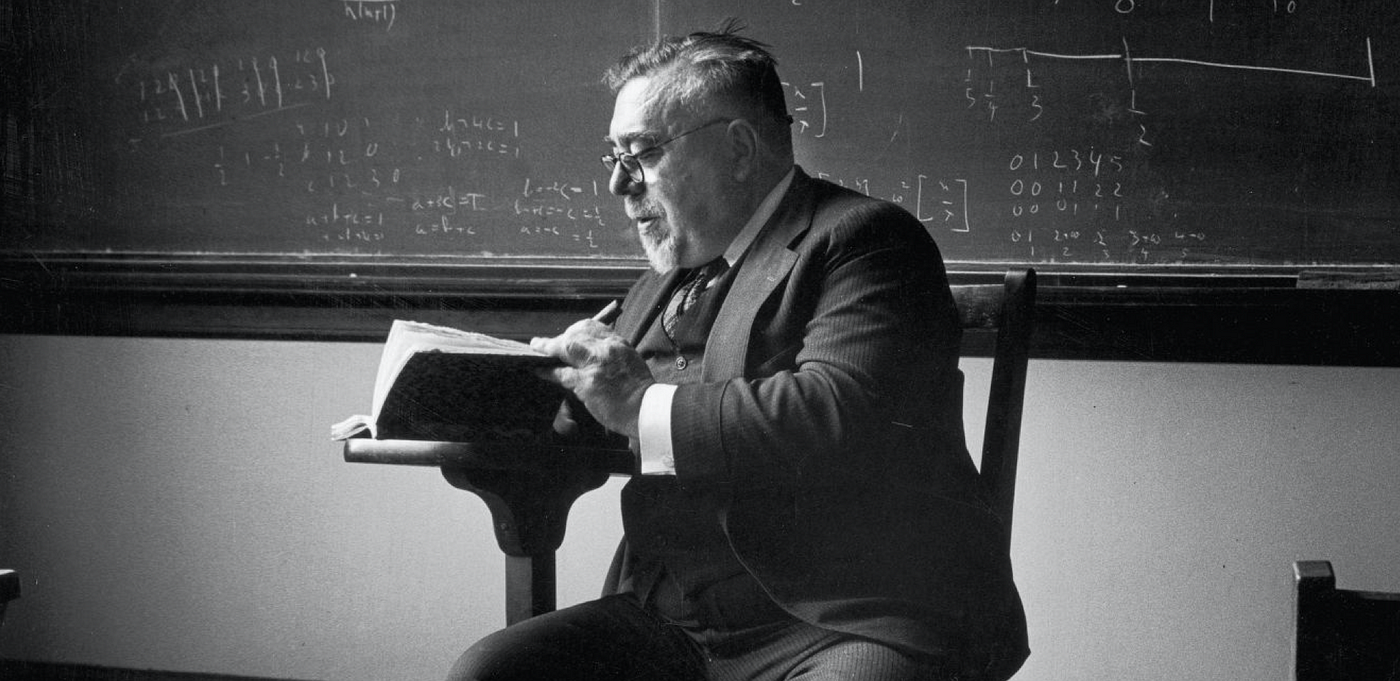

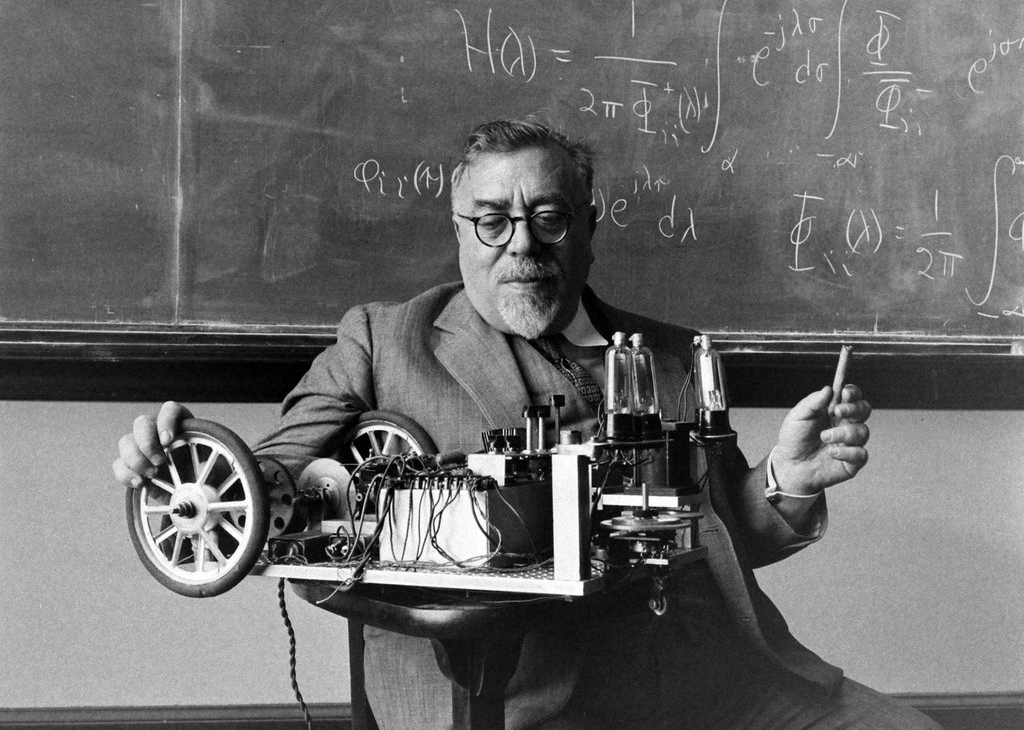

De Beauvoir’in zamanında, internetin doğuşundan ve algoritmaların altın çağından çok önce, vizyon sahibi matematikçi, filozof ve sibernetik öncüsü Norbert Wiener (26 Kasım 1894 – 18 Mart 1964), 1954’te şaşırtıcı bir şekilde bu soruna değindi. İnsanın insanı kullanımı şimdiki teknolojik gerçekliğimizi şekillendiren ve son zamanlarda ihmal edilen ahlaki boyutu, yapay zekâ ve geleceğe ilişkin tartışmaya açmaya istekli yeni nesil düşünürler tarafından keşfedilen, bir nevi dijital öncüleri etkileyen fikirleri ele alıyor.

İnsanın insanı kullanımı’ndan 10 yıl sonra, Wiener bu fikirleri Yale’de bir dizi konferansta ve Paris yakınlarındaki Royaumont Manastırı’nda bir felsefe seminerinde, God & Golem, Inc. (halk kütüphanesi) ele aldı. MIT Press tarafından yaşamının son yılında yayınlanan kitap, ertesi yıl yeni kurulan Bilim, Felsefe ve Din kategorisinde ölümünden sonra Ulusal Kitap Ödülü’nü kazandı.

Wiener yapay zekâların ahlaki kararlar vermeye başladığı bir geleceği düşündü – 1964’te zamanının ilerisinde bir düşüncesi vardı. Wiener şöyle diyor:

İyiliği teşvik etmek, kötülükle savaşmak, birbirleriyle iki net çizgide birleştirmek ve sorgusuz sualsiz diğer tarafta düşmanlarımız ve bizim tarafımızda güvenilir müttefiklerimiz olduğunda göreceli olarak kolaydır. Bununla birlikte, her seferinde ve her durumda sormamız gerekirse, dost nerede ve düşman nerede? Üstelik doğru soruları önceden sormaları gereken ve tam olarak hangi süreçlerin yanıtlanacaklarını anlamayan bir sihirbazın ya da bir makinenin ellerine karar mekanizmasını vermemiz gerektiğinde ne olacak?

Wiener, doğru soruları sormak için hem teknolojik hem de etik soru sorma konusundaki bilgisi değil, aynı zamanda bu gibi düşünceleri gölgeleyen sayısız nüansa dair bir anlayışı da gerektirir ki birçok durumda insanın yargılamasına yetecek kadar zorlayan inceliklerdir. Önceden programlanmış makineler tarafından çeşitli bağlamlarda ayrım gözetilmeksizin uygulanacak bir dizi işlemsel kural içinde kodlanması imkansızdır. Yarım asır sonra, Tramvay sorunundaki varyasyonlar, bu soruları kendi kendine süren arabalardan yaşlı bakım uzmanlarına kadar her şeyin arkasındaki teknolojiyi göz önünde bulundurarak keskin bir rahatlamayı sağladığı için, Wiener’in sözleri hem rahatsız edici hem de heyecan verici bir şekilde bilgece geliyor. Teknolojik açıdan güçlü ancak ahlaki açıdan fakir algoritmalara günümüzde aşırı güven veren üreticilerin dikkat etmesini tavsiye eden Wiener, Rachel Carson’ın gelecek nesillere tavsiyelerini tekrarlıyor ve şöyle diyor:

Gelecek, yeni mekanik kölelerimizin bize düşünmeden yaşayabileceğimiz bir dünya vermesini bekleyenler için çok az umut veriyor. Bize yardımcı olabilirler, ama dürüstlüğümüz ve zekâmız için yüksek talepler pahasına. Geleceğin dünyası, robot kölelerimizden bir şeyleri yapmalarını bekleyerek uzanabileceğimiz rahat bir hamak değil, zekâmızın sınırlarına karşı daha zorlu bir mücadele olacak.

Braingpickings (İng.)

Çeviren: tabutmag